�����˹����ܳ�����˾OpenAI�ڽ�����������������̫ƽ��ʱ���糿10�㣨����ʱ�������賿2�㣩��ʼ������Ϊ��12��Ĵ��·������ڡ���˾��������д����“12�졢12��ֱ����һ�Ѵ��СС���¶�����OpenAI��12���ڴ����쿪ʼ��”

OpenAI����ϯִ�й�ɽķ·��������Sam Altman��¶����λ����ÿ��һ��ֱ������ʽչ����ÿ�������շ���һ���²�Ʒ����Ʒ���ݿƼ�ý�� The Verge Ԯ��֪����ʿ¶����Щ�²�Ʒ�а����û����ڴ��Ѿõ�����ת��Ƶ���� Sora ��һ���µ�����ģ�͡�ǰ OpenAI ��ϯ������ Mira Murati �� 3 �·ݸ��� ���������ձ��� ��Sora ���ڽ���������С�

����֮�⣬OpenAI ���ܻ�� ChatGPT ����ģʽ����һ����ʥ�����ˡ��������Ѿ����û��ڴ����������ģʽ�İ�ť���Ա��ѩ������״��

ͼƬ��Դ��ɽķ·������ X�ٷ�

���������㣺���ܷ����IJ�Ʒ������

������ϤOpenAI�ڲ��ƻ�����Ϣ��ʿ������Ʋ⣬���λ�����Ƴ����²�Ʒ���ܣ�

l Sora���ı�ת��Ƶ���ߣ�֧�ָ�������Ƶ���ɣ�Ϊ�����ߴ����¿����ԡ�

l O1����ģ�ͣ���ǿ������ģ�ͣ����ΪGPT-4�ļ����ߡ�

l ��ͼ��ģ�ͣ�����������е�DALL-E��������һ������ͼ������������

l ����ģʽ��ǿ��������Ʒ�������ϳɺ���Ȼ�������������ܡ�

l �����߹���������ͨ���Ľ�API�ӿڣ���չAI�����������е�Ӧ�á�

l ȫ�´�����ܣ�“����Ա”��ܣ���֧���û����ճ�������ʹ��AI�����Զ���������

ͼƬ��Դ������

��Sora����������AI���ݴ����·�ʽ

�ۺ� OpenAI �Ĵ�����ʷ���û��������˴λ������֮һ����Sora���Ƴ�������ı�ת��Ƶ���ߴ�ǰ�ѽ���Alpha���ԽΣ����ܵ������������ҵ����á�����Sora��ǰ����Թ����еİ�Ȩ������ܵ�һЩ����������ʽ�����Ա��ܹ�ע��

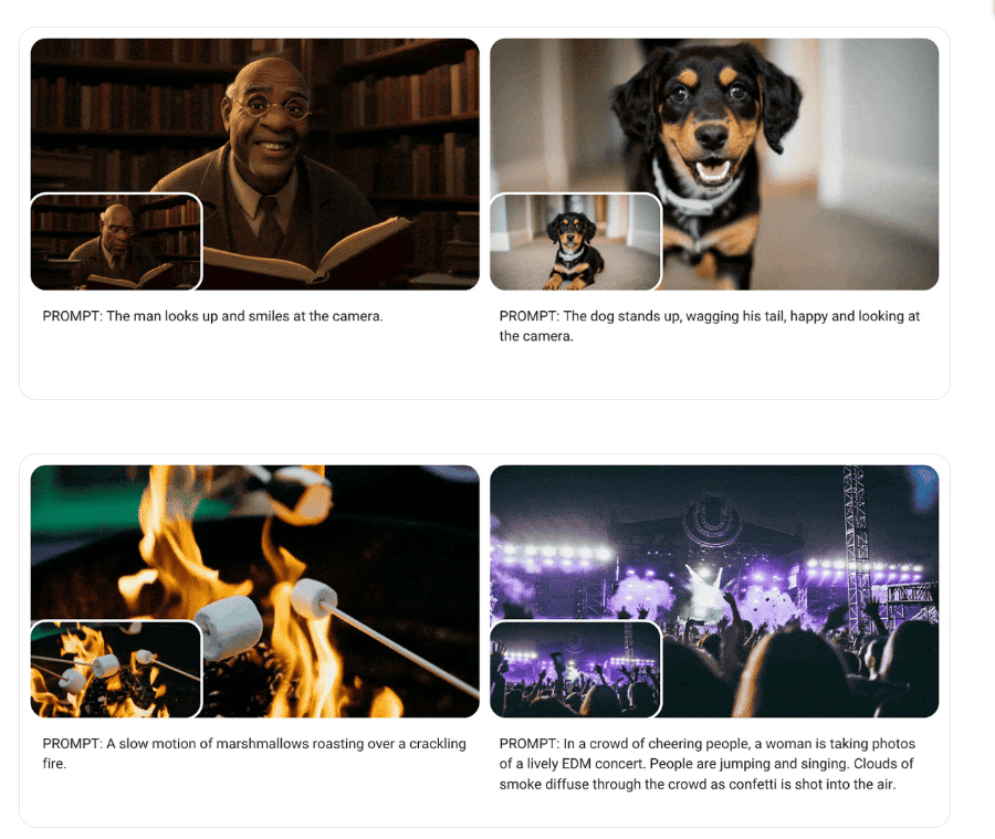

Soraͨ�����ͼ����Ƶ�Ͷ�̬����������������SoraΪ���������ߡ�����������Ӱ�������Ŷ��ṩ��ȫ�µĹ��ߣ������ɳ���1���ӵĸ�����Ƶ������������������������Ч���봴��ռ䡣

����������ʽAI��Ƶ���ߣ��Ƿ�����

�Դӽ���SORA����֮��������ʽAI��Ƶ���������˺ܴ�IJ���������������AI��Ƶ�����ڷ����¹���ʱҪ��SORA����������Sora�����ɳ��ȡ������Ժͼ������·�������������ƣ���ʹ��������֮�����ض����ܺ�Ӧ�ó����в��������Լ����ص�������ӭ��SORA�����ij����

Ŀǰ������AI��Ƶ���ߣ�

1. �ȸ� Veo

�ȸ���12��3���Ƴ���Veo�������ǹȸ��“SORA”���ٷ������ǹȸ���ǿ�����Ƶ����ģ�ͣ����ɵ���Ƶ�����������档�ӷų�����Ƶ������ͼ����Ƶ��������Ƶ��Ч�����ܸ��岢��ϸ���ϴ����ĺ�ϸ�¡�

ͼƬ��Դ�ڹȸ�

2. Meta Movie Gen

Meta��10��5�շ�����Movie Gen������һ��AI��Ƶ���ɹ��ߣ��ų�META��Sora��Sora�е������У��ɴ�����ͬ���߱ȵĸ��峤��Ƶ��֧��1080p��16�롢ÿ��16֡��Soraû�е������У����������ı������ֺ���Ч�������ı�ָ��༭��Ƶ���Լ������û��ϴ���ͼ�����ɸ��Ի���Ƶ��Meta��ʾ������“����Ϊֹ���Ƚ���ý�����ģ�ͣ�Media Foundation Models��”��ֻ��һ��“�ѵ�����ɷ�����е�����”�������滻��Ƶ�е����壬ͬʱ����������ȷ�����˱�����������Soraֻ����ʾ�������Ͳ�ͬ��Meta��92ҳ�������аѼܹ���ѵ��ϸ�ڶ������ˡ�

3. Adobe Firefly Video Model

Adobe��10��������������������ʽAI��Ƶ��������Firefly Video Model�����������Щʱ���Ƴ���OpenAI��Sora�������ù��߿ɸ����ı������;�̬ͼ�����ɶ���ƵƬ�Σ����ṩ�ɶ��Ƶ���������ơ�Adobeǿ����Firefly����ѵ�����ɱ����Ȩ���⡣

��ȻAdobeĿǰû�������κ���ʽ�ͻ��������¿������µļѵ��ֹ�˾����һ����վ��ʹ������ͼ������ģ��Ϊ�ͻ�����ƿ�ӣ���̩��˾Ҳһֱ��ʹ��Adobe���߸��������ű�����ϵ�еİ�װ��

4. Runway Gen-3

Runway��Gen-3ģ�Ϳ��Ը����ı���ͼ�����Ƶ��ʾ���ɶ���ƵƬ�Σ�֧�ֶ��ַ��ͳ�������ģ������ѧϰ3D��̬���ܹ�������Ƭ����ʵ����Ƶ���ر������������ҵĴ������̡���Ŀǰ�û�ʹ����㷺������AI���ߣ�ĿǰRunway���Ƴ�������ƣ�Camera Control�����ܣ�������Ƶ��������Ƕ��˾���ģ����������һ�����ַ�

5. Pika

Pika Labs�Ƴ���Pika���������û�ͨ���ı���ͼ����ʾ����3D��������������ͨ���Ӱ������Ƶ��Pika 1.5�汾������"Pikaffects"��Ч�⣬��ǿ����Ƶ���ݵ�רҵ�ʸкʹ���Ч����

6. PixVerse

��ʫ�Ƽ���PixVerse֧���ı�������Ƶ��ͼƬת��Ƶ�ȹ��ܣ��û����Կ�����������ƵƬ�Ρ�PixVerse V2�汾����Diffusion+Transformer�ܹ�����������Ƶ�ķֱ��ʡ�ϸ�ںͶ������ȡ�

7. �ֽ������ļ���AI

�ֽ������ļ���AIӦ���ܹ������ı���ʾ������Ƶ���ṩ���ķ����û�ÿ�¿�����Լ168��AI��Ƶ����Ӧ�����ֽ��������µ�Faceu Technology���������ڶ��ƽ̨���ߡ���Ŀǰ��дʵ�����ϻ��������һЩ�����ܺ�RUNWAY��Ч����ȡ�

8. ����AI����Ӱ

����AI����Ƶģ����Ӱ����֧������5���10�����Ƶ���ֱ��ʿɴ�768P����֧��16֡���������������CogVideoXģ��������prompt���ܹ��������������������ԣ�Ч�������档��ģ����11�µ��°汾��������CogSound��Чģ�ͣ��������뻭��ƥ�����Ч�����һ����AI�Ѿ��߱�������������������Ӱ�������Ƶ����ȫҪ�أ������ڲ�����Ҳ�Ƿdz����ù�����SORA��������û��ʵ�֡�

9. Luma AI��Dream Machine

Luma AI�ڽ��췢�������µ���Ƶ����ģ��Luma Ray 2��ͬ����SORAһ�����֧������1���ӵ�һ������Ƶ��Ӫ����Ҳ����LUMA��SORA�������ٶ�ֻ��10�롣����Luma AI����ģ�ͣ��ѱ�����ѷAmazon Bedrockƽ̨���ȼ��ɡ���Ч���Ͽ�Ҳ�Ƿdz����촽����·��ͷ��˿���ʸС�һ������ë��������Ƥ����Ƥϸ������������

ͼƬ��Դ��LUMA X�ٷ�

10. Stable Diffusion

Stable Diffusion��Stability AI�Ƴ��Ŀ�Դ�ı�����ͼ��ģ�ͣ��㷺Ӧ���������������������ͨ����ɢģ�ͣ�Stable Diffusion�ܹ����ɸ���������������ͼ������Ƶ����SVDĿǰ�������Ƚ����ޣ���Ҫ������ͼƬ���ɺͿ�������

11. VIDO

VIDO�������Ƽ��Ƴ���������Ƶģ�ͣ�֧���ı�������Ƶ��ͼƬת��Ƶ���ܣ��ṩдʵ�Ͷ������ַ��VIDO����Diffusion Transformer�ܹ����ܹ�����4����8�����ƵƬ�Σ������ٶȽϿ죬������ƾ��е�Ӱ��ӳ���ķ��

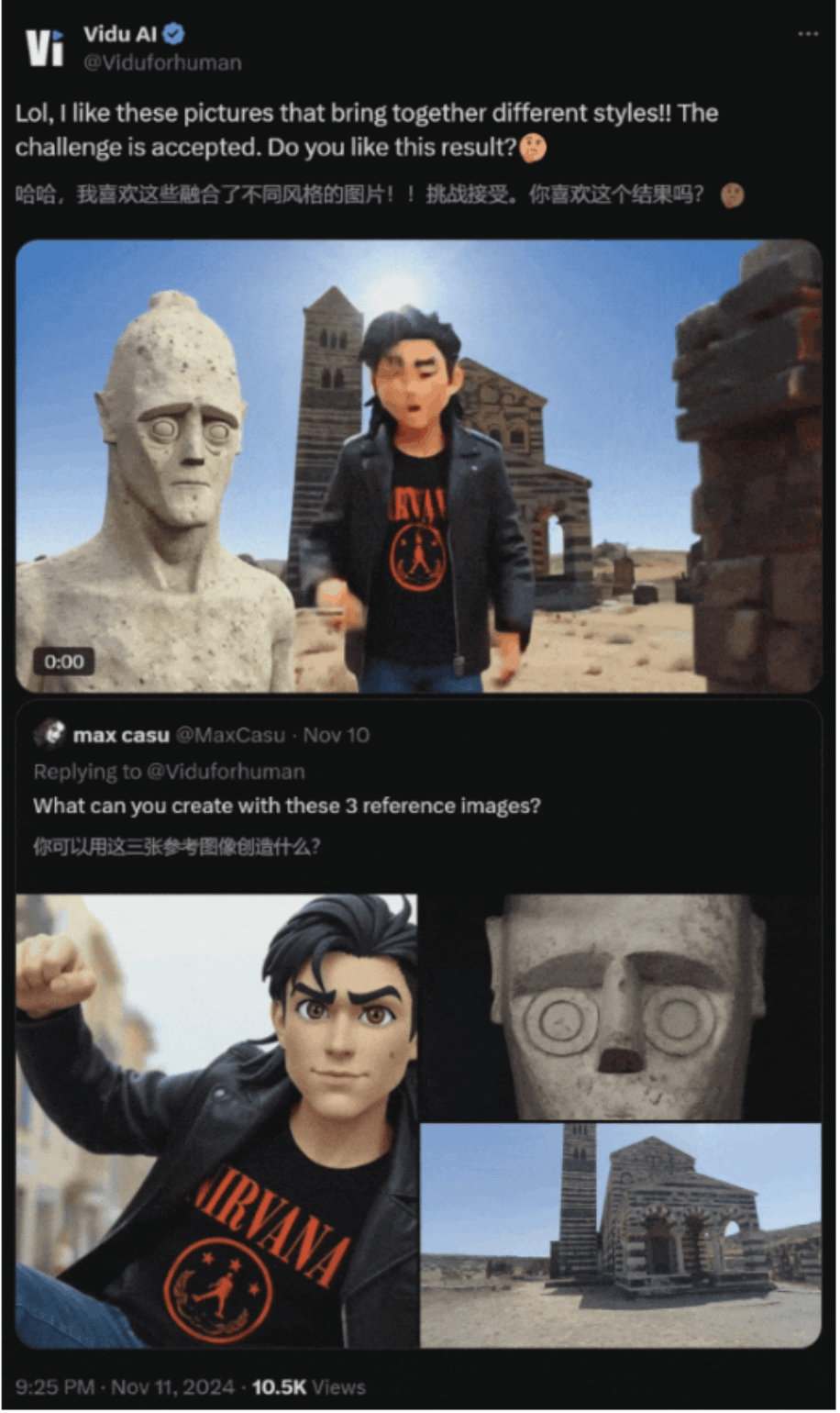

����11�������˶�����һ���ԵĹ��ܣ��������֧���ϴ�1��3�Ų��գ���ʵ�ֶԶ�����Ŀ��ơ����Ը�����ȷ�ص㡢�����Ϊ��������ʵ�־����ƺͱ༭��δ��“ֻҪ�ϴ�һ�Ž�ɫͼ+һ�Ż���ͼ”�Ϳ��Դ�����������Ƶ���¡�

ͼƬ��Դ��VIDU X�ٷ�

12. ��Ѷ��Ԫ��ģ��

��Ѷ��Ԫ��ģ������Ѷ�Ƴ��Ķ�ģ̬AIģ�ͣ�����12��3�տ�Դ�����й��ܲ�����Ϊ��Ѷ��SORA��130�ڲ�������ΪĿǰ���������Ŀ�Դ��Ƶ����ģ�͡��ٷ��������г�дʵ���ʣ�ģ�����ɵ���Ƶ���ݾ߱������ʸС���ʵ�У������ڹ�ҵ����ҵ����������������������Ƶ���ɵ���ҵӦ�á�Ŀǰ�û���ʵ���������Ǻܶࡣ

13. ����

�����ǿ����Ƴ���������Ƶ��ģ�ͣ��ܹ����ɴ���Ⱥ����˶���ģ�������������ԣ����ɵ���Ƶ�ֱ��ʴ�1080p��ʱ����ɴ�2���ӡ��������µ�1.5�汾�������˶���ˢ���ܺ�RUNWAY�ı�ˢ�������ơ������������Sora��DiT�ṹ����ģ���е����ռ��/���롢ʱ��ģ��ģ�������ά��ʵ�ֲ��־�����ʵ����۵�����֧�֡���Ŀǰ�����û�������ԱȽϸߵ�AI��Ƶ���ɹ��ߡ�

ͼƬ��Դ������λ

�ڼ��ҵ���ҵ���������£����ѿ����ֹ�˾���ڸ��²�Ʒ�Ĺ�����ͻ���������Ӳ�Ʒ�������ƺ��ܶ˾��������SORA�Ŀ������¹���ҲҪ��SORA����������֤���Լ��IJ�Ʒ�����������SORA�ƺ����Ҫ���ˣ��Dz��ǿ�����ʵ��PKһ���ˡ�

��Դ����һ�綯��

���ߣ�����

������������վ���ش��Ľ�������Ϣ������������ζ����ͬ��۵㼰�����������е���Ȩ��Ϊ���������Ρ����漰��Ȩ�����⣬����������ϵ����ϵQQ��26887486�������ǽ���ʱɾ��������

�������ӣ�https://www.yunlianauto.com/article/51/50151.html